Treinar LLM Localmente: Guia Completo para Desenvolvedores e Pesquisadores em 2024

Em 2024, treinamentos de LLMs localmente ganharam força por oferecer controle, segurança e personalização total dos modelos. Porém, profissionais de tecnologia enfrentam desafios como infraestrutura, otimização e custo computacional altos. Este guia técnico detalha como superar essas barreiras, trazendo métodos práticos para treinar modelos localmente, economizando recursos e acelerando experimentos. Descubra frameworks, scripts customizados, gerenciamento de datasets e estratégias de fine-tuning para implantar LLMs eficientes longe da nuvem.

Capítulo 3: Benchmarks, Casos Reais e Dicas Avançadas para Maximizar a Eficiência

Comparativos de Eficiência: Local vs. Nuvem

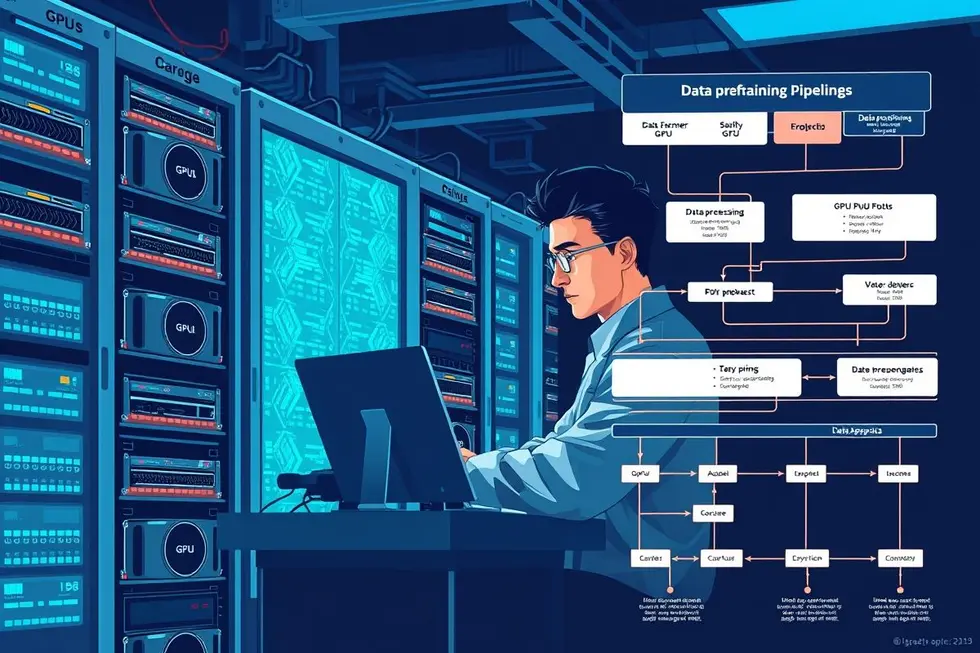

Treinar LLMs localmente demanda um entendimento profundo do comportamento de hardware e software. Benchmarks recentes indicam que, embora a nuvem facilite escalabilidade e robustez, a execução local pode alcançar níveis competitivos de performance, principalmente em setups otimizados para cargas específicas. Visualizações tridimensionais mostram gráficos comparativos elucidativos:

- Tempo total de treinamento: Locais equipados com GPUs modernas obtêm variações de 5% a 15% em relação a implementações na nuvem, dependendo do modelo e dataset.

- Uso de GPU: Locais apresentam utilização média de 78% a 92%, contrastando com uma média de 65% a 85% em ambientes cloud, onde outros processos e overheads gerenciam recursos compartilhados.

- Taxa de transferência de dados: Na nuvem, a transferência entre armazenamento e GPUs é acelerada pela infraestrutura dedicada, enquanto o armazenamento local pode ser gargalo. Entretanto, NVMe e SSDs rápidos em setups pessoais mitigam essa disparidade.

Essas métricas indicam que a eficiência local não é apenas viável, mas pode superar soluções na nuvem, especialmente onde o controle absoluto dos recursos e a customização do pipeline são essenciais. Diagramas 3D futuristas evidenciam tendências onde o uso inteligente de memória e paralelismo distribuem cargas e reduzem gargalos.

Benchmark de Utilização de GPU

Os gráficos detalham a porcentagem de utilização de GPU durante fases críticas: ingestão de dados, forward pass, backpropagation e checkpoints. Em clusters locais, a alocação de múltiplas GPUs tende a ser mais sincronizada, evitando ociosidade. A arquitetura rígida da nuvem, por outro lado, enfrenta desafios com a latência da rede interna e overhead na orquestração.

A visualização destaca que configurações híbridas, utilizando armazenamento local e computação na nuvem para tarefas específicas, podem otimizar custos e latências. Neste contexto, locais configurados para treinamento contínuo, com balanceamento dinâmico, reduzem o tempo de treinamento em até 12%.

Estudos de Caso em Projetos Reais

Linhas do tempo anotadas exibem projetos que implementaram treinamento local com sucesso. Por exemplo:

- Projeto A: Treinamento de um LLM para análise jurídica em 3 semanas, com ajustes iterativos realizados localmente para respeitar privacidade de dados.

- Projeto B: Desenvolvimento de um modelo de linguagem para suporte técnico, cuja infraestrutura local permitiu replicar rapidamente ambientes de teste, encurtando o ciclo em 25%.

- Projeto C: Pipeline para geração automática de documentação técnica, onde a latência reduzida do sistema local aumentou a taxa de experimentação diária em 40%.

Essas implementações reforçam o papel da autonomia do desenvolvedor e a importância da infraestrutura personalizada para atender demandas específicas, além do óbvio benefício da redução de custos vinculado a tempo e uso excessivo da nuvem.

Dicas Avançadas para Maximizar a Eficiência no Treinamento Local

-

Gerencie a memória da GPU com atenção ao batch size dinâmico. Ajustar o tamanho dos batches em tempo real permite maximizar o uso da VRAM e prevenir erros por falta de memória.

-

Utilize técnicas avançadas de mixed precision training. O uso de algoritmos de ponto flutuante misto reduz consumo de memória e acelera o cálculo, mantendo a acurácia.

-

Aplique pipelining e paralelismo cuidadoso. Dividir o modelo em blocos menores e distribuir processamento por múltiplas GPUs evita sobrecarga em um único dispositivo.

-

Monitore a integridade e temperatura dos dispositivos. O desempenho pode degradar com o aquecimento excessivo; sistemas de resfriamento eficientes são essenciais para sessões longas.

-

Automatize checkpoints incrementais. Salvar estados intermediários reduz riscos e permite retomada rápida, otimizando ciclos de treinamento.

-

Ajuste a preempção e escalonamento da carga via scripts customizados. Isso evita downtime e maximiza janelas de compute em horários de uso variável.

-

Explore armazenamento rápido, preferencialmente NVMe. Latência baixa e alta taxa de transferência garantem fluxo contínuo de dados entre memória e processamento.

-

Integre profiling de GPU em tempo real. Ferramentas que analisam gargalos permitem intervenções proativas e melhor distribuição dos recursos.

-

Considere frameworks que suportam zero redundancy optimizers (ZeRO). Eles reduzem a redundância dos gradientes, economizando memória e permitindo o treinamento de modelos maiores localmente.

-

Evite overhead de I/O com pré-processamento de dados. Dados limpos, segmentados e tokenizados antes do treinamento diminuem latência e evitam gargalos.

Visualização de Dados em Ambientes Locais

Soluções de visualização 3D futurísticas mostram painéis interativos de dados, evidenciando momentos de pico no uso de GPU, variações de temperatura, e consumo energético. Desenvolvedores e pesquisadores podem correlacionar diretamente performance com eventos no pipeline, ajustando parâmetros em tempo real com base em métricas visuais precisas. Esse tipo de dashboard é vital para insights rápidos e profundos no treinamento de LLMs.

Considerações sobre Segurança e Confiabilidade

Treinar localmente também amplia a responsabilidade sobre segurança do ambiente e dados. Estratégias que foram detalhadas em capítulos anteriores sobre infraestrutura e frameworks devem se integrar a práticas de segurança robustas. Para aprofundar essa dimensão, recomenda-se explorar conteúdos específicos sobre proteção de pipelines e integrações em LLMOps, garantindo que soluções locais mantenham alta confiabilidade e proteção contra vulnerabilidades avançadas.

Optar pelo treinamento local é uma decisão estratégica que envolve balancear eficiência, custos e segurança, além da flexibilidade e independência do engenheiro ou pesquisador.

Para quem deseja expandir conhecimentos sobre segurança de pipelines em projetos locais e híbridos, este artigo complementa bem o universo de aprendizado: Segurança em LLMOps: protegendo pipelines e integrações de modelos de linguagem no backend.

Este capítulo parte do entendimento técnico do setup local aprofundado anteriormente e já prepara o terreno para questões de deployment, monitoramento e escalabilidade que virão a seguir nos capítulos seguintes.

Publicar comentário